Desde la adopción masiva de los Modelos de Lenguaje Grande (LLMs) como ChatGPT o las "AI Overviews" integradas en motores de búsqueda, la adquisición de información ha experimentado una transformación radical. La promesa es clara: máxima eficiencia mediante la síntesis inmediata de datos. Sin embargo, en el ámbito de la psicología cognitiva y la educación, surge una pregunta ineludible:

¿Cuál es el costo cognitivo de delegar el proceso de búsqueda y síntesis a una inteligencia artificial?

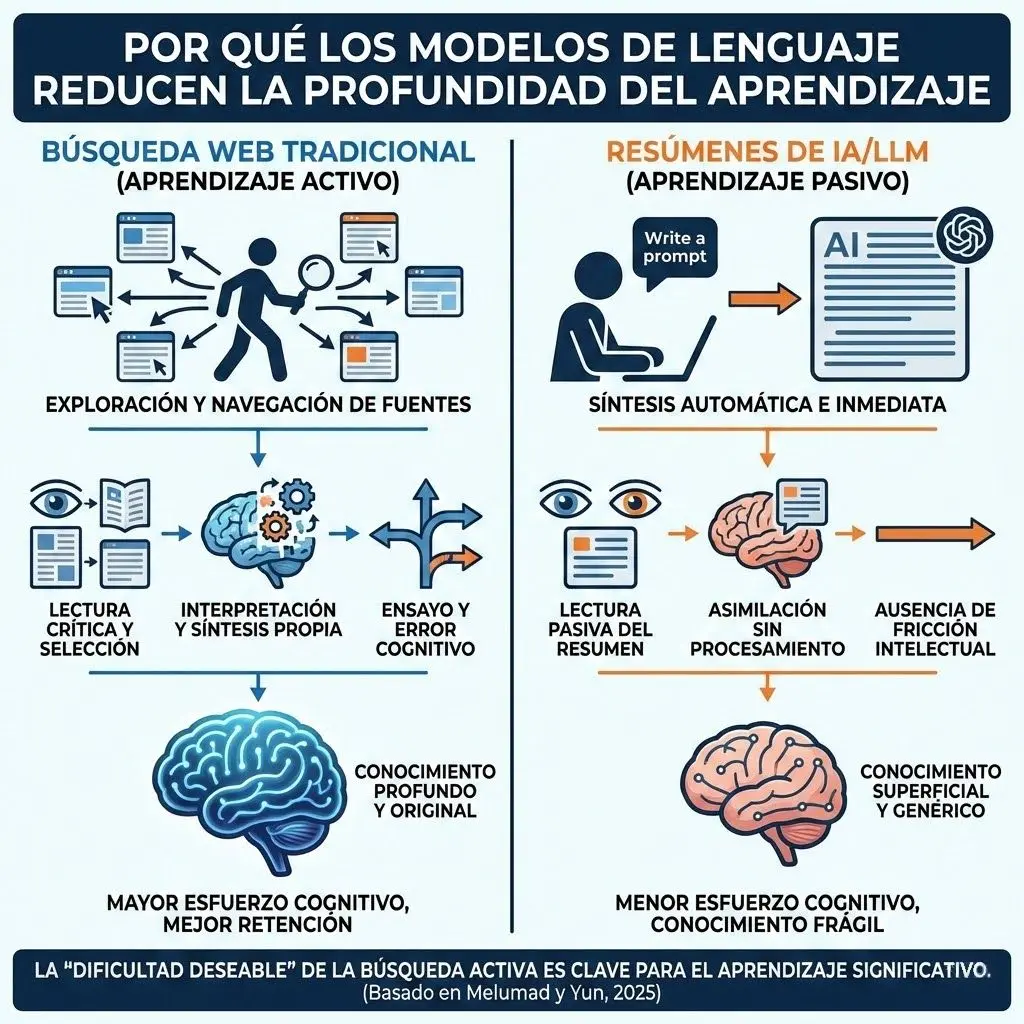

Para llenar este vacío empírico, la investigación dirigida por Melumad y Yun (2025) aborda directamente el impacto de la modalidad de adquisición de información en la profundidad del aprendizaje. Mientras que la búsqueda web tradicional exige que el usuario navegue, interprete y estructure la información por sí mismo, los LLMs realizan este trabajo de "dar sentido" (sensemaking) de forma automática. El trabajo de Melumad y Yun plantea que esta facilidad suprime un proceso crítico de aprendizaje exploratorio, transformando un ejercicio activo en uno pasivo.

La síntesis inmediata y el espejismo del aprendizaje

Durante los últimos años, el desarrollo de herramientas impulsadas por inteligencia artificial ha cambiado drásticamente los hábitos de estudio e investigación. Entrenados con vastas colecciones de texto y arquitecturas de aprendizaje profundo, los modelos actuales no solo recuperan información, sino que la procesan, traducen y, lo más crítico para el ámbito académico: el resumen.

Hoy en día, es una práctica común entre estudiantes y profesionales utilizar un LLM para extraer las ideas principales de manuales extensos o papers científicos en cuestión de segundos, eliminando la necesidad de leer los textos completos. Aunque esto optimiza el tiempo, altera fundamentalmente la mecánica de asimilación.

Históricamente, el aprendizaje profundo ha dependido de la "fricción intelectual": el acto de buscar, evaluar fuentes contradictorias y destilar ideas complejas.

El problema central que Melumad y Yun identifican es que, al interactuar con resúmenes generados por IA, el usuario se convierte en un receptor pasivo. Al no tener que ensamblar el conocimiento por cuenta propia a partir de múltiples piezas de información, se pierde una etapa vital del procesamiento cognitivo.

En este escenario de alta comodidad tecnológica, Melumad y Yun se plantearon investigar si este atajo en el esfuerzo inhibe nuestra capacidad para desarrollar un conocimiento enraizado y original, generando una mera ilusión de competencia donde, en realidad, solo existe una comprensión superficial.

La ilusión de la eficiencia cognitiva

El estudio de Melumad y Yun demuestra consistentemente que delegar la síntesis de información a la IA tiene consecuencias directas en la asimilación del conocimiento y en la calidad del rendimiento posterior. Sus hallazgos revelan lo siguiente:

Conocimiento más superficial

Los participantes que utilizaron resúmenes de LLM desarrollaron un nivel de conocimiento significativamente menos profundo en comparación con aquellos que navegaron por enlaces web tradicionales.

Reducción del esfuerzo cognitivo

La inmediatez de la IA redujo la inversión de esfuerzo mental. Al no tener que ensamblar activamente la información, los usuarios experimentaron una caída en el procesamiento profundo.

Producción de contenido genérico

Al solicitarles que generaran consejos basados en lo aprendido, el grupo que utilizó IA produjo textos objetivamente más cortos, con menos referencias a hechos concretos y carentes de originalidad semántica.

Efectos en cascada negativos

Evaluadores independientes (ciegos al método de búsqueda original) calificaron los consejos derivados de la IA como menos útiles, menos informativos, menos confiables y con menor probabilidad de ser adoptados.

Baja apropiación del conocimiento

Los usuarios de IA reportaron sentirse menos involucrados y con menor sentido de propiedad intelectual sobre las recomendaciones que ellos mismos redactaron.

Metodología del estudio y limitaciones

Para aislar estas variables, Melumad y Yun diseñaron un total de siete experimentos controlados con una muestra masiva (n = 10,426 participantes) en entornos de laboratorio y plataformas online. Cuatro de estos estudios conforman el núcleo principal de su artículo, mientras que los tres restantes sirvieron como replicaciones conceptuales (incluidas en el material suplementario) para dotar de robustez a sus hallazgos.

Asignaron aleatoriamente a los sujetos a aprender sobre temas cotidianos (ej. cómo plantar un huerto o llevar un estilo de vida saludable) utilizando motores de búsqueda estándar (Google) o interfaces de síntesis de IA (ChatGPT o Google AI Overview). Posteriormente, se les pidió redactar consejos sobre el tema. En el cuarto experimento central, un grupo independiente de "receptores" evaluó a ciegas la calidad de dichos consejos.

Para mantener el rigor y la honestidad intelectual, los propios Melumad y Yun señalan limitaciones críticas en su diseño:

- Contexto de la tarea: Los resultados se enmarcan en la tarea específica de aprender para dar consejos. El uso de LLMs para buscar datos puntuales (conocimiento declarativo) podría no presentar estas desventajas.

- Métricas de aprendizaje: La profundidad del conocimiento se midió a través de autoinformes, el análisis cualitativo del texto producido y la percepción de terceros. No se utilizaron pruebas estandarizadas de rendimiento, lo que deja espacio para futuras investigaciones objetivas.

- Motivación extrínseca: Al utilizar participantes remunerados en plataformas como Prolific, la motivación intrínseca por la calidad del consejo era baja. En escenarios del mundo real con altas implicaciones personales, los resultados podrían variar.

- Complejidad del dominio: El estudio se centró en temas accesibles sin necesidad de conocimientos previos profundos. En disciplinas altamente especializadas (matemáticas avanzadas, física), los resúmenes de IA podrían, paradójicamente, facilitar la comprensión inicial.

Implicaciones para la Práctica Profesional

El trabajo de Melumad y Yun (2025) es una advertencia fundamental contra la "desprofesionalización" (deskilling) de nuestras capacidades de aprendizaje activo. En psicología cognitiva, el concepto de "dificultad deseable" subraya que el esfuerzo invertido en superar obstáculos durante el aprendizaje—como el ensayo y error de navegar por múltiples fuentes—fortalece la retención y la comprensión profunda.

Cuando dejamos que un LLM "haga el trabajo de buscar" por nosotros, estamos sacrificando la construcción de conocimiento procedimental (entender cómo y por qué funcionan las cosas) a cambio de conocimiento declarativo empaquetado. Esto implica que el uso de IA debe ser estratégico: excelente para estructurar o revisar, pero potencialmente perjudicial si sustituye la lectura crítica, la curaduría de fuentes y el esfuerzo personal de síntesis.

Fuentes y recursos de información

Melumad, S. & Yun, J. (2025). Experimental evidence of the effects of large language models versus web search on depth of learning. PNAS Nexus, 4, (10). DOI: 10.1093/pnasnexus/pgaf316